2024. 08. 13. - 08:20

„Katasztrófa-recept” - Arcunk alapján árul el rólunk mindent a mesterséges intelligencia

Zavarbaejtő dolgokat képes elmondani rólunk a mesterséges intelligencia csupán az arcunk alapján – állítja Michal Kosinski tudós, aki ezt az MI-t maga építette.

Arcunk alapján képes egészen zavarbaejtő dolgokat elmondani rólunk a mesterséges intelligencia, amelyet Michal Kosinski épített.

A tudós állítja, hogy mesterséges intelligenciája nagy pontossággal képes észlelni az intelligenciánkat, szexuális preferenciáinkat és politikai beállítottságunkat, pusztán az arc szkennelésével – írta meg a Business Insider.

A mesterséges intelligenciának elég az arcunkat látnia

Vagyis, mindössze azzal, hogy az arcunkra néz, a mesterséges intelligencia számára kevés titkunk marad.

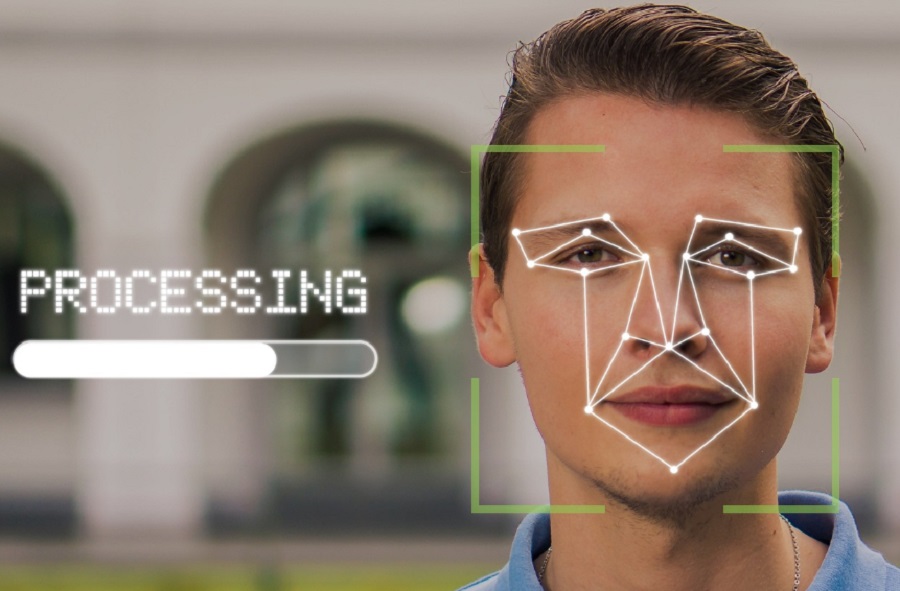

Természetesen Kosinski munkája számos etikai kérdést felvet. Felmerült az is, vajon ez a fajta arcfelismerési kutatás a frenológia csúcstechnológiás változata-e, a 18. és 19. században népszerű áltudományé, amely az arcvonások és mentális tulajdonságaik közötti összefüggéseket kereste. Olvasd el: Már megszületett az ember, aki 1000 évig él - MI és robotsegítséggel

Arcunk alapján árul el rólunk mindent a mesterséges intelligencia

Kosinski szerint egyáltalán nem így van. Ha valami, akkor az arcfelismeréssel kapcsolatos munkája figyelmeztetés: a döntéshozók figyelmét hívja fel a kutatásai és mások hasonló munkájának lehetséges veszélyeire.

Egy 2021-ben publikált tanulmányában például Kosinski olyan arcfelismerő modellt dolgozott ki, amely 72 százalékos pontossággal képes megjósolni egy személy politikai meggyőződését pusztán az arcáról készült fénykép beolvasásával, szemben az emberek 55 százalékos pontossági arányával.

„Tekintettel az arcfelismerés széles körben elterjedt használatára, eredményeink kritikus hatással vannak a magánélet és a polgári szabadságjogok védelmére" - írta Michal Kosinski a tanulmányban.

Figyelmeztetés a döntéshozóknak?

Bár Kosinski állítja: kutatását figyelmeztetésnek kell tekinteni, munkája inkább Pandora-szelencének tűnik. Kutatása számos felhasználási esete tűnik meglehetősen rossznak, s pusztán közzétételük új eszközöket inspirálhat a diszkriminációhoz.

Probléma az is, hogy a modellek nem 100 százalékig pontosak, ami az emberek nem megfelelő megcélzásához vezethet.

Amikor például Kosinski 2017-ben publikált egy tanulmányt egy arcfelismerő modellről, amely 91 százalékos pontossággal képes előre jelezni a szexuális irányultságot, a Human Rights Campaign és a GLAAD „veszélyesnek és hibásnak” nevezte a kutatást – ugyanis felhasználható az emberek megkülönböztetésére.

Ha hozzáadjuk ezt a technológiát a dúló kultúrháborúkhoz – például az olimpiai sportolók nemével kapcsolatos félrevezetést 2024 nyarán –, ez maga lehet a katasztrófa receptje.

Rengeteg valós példa van már arra, hogyan rontja az arcfelismerés az emberek életét és jogait - például a Rite Aid, amely tisztességtelenül azonosítja a kisebbségeket bolti tolvajokként, vagy a Macy's áruház esetét, amely ok nélkül hibáztatott egy férfit erőszakos rablásért, amelyet nem ő követett el.

Amikor tehát közzéteszik Kosinski kutatását, figyelmeztetésnek szánják – ám mindez kicsit olyan érzés is, mintha részletes utasításokat adnának a betörőknek, akik ki akarják rabolni a házat – írta a Business Insider.

B.A.